来源: 发布时间:2025-06-10 12:21:10 阅读量:2148

导读

主要工作:

本论文提出了一种创新的需求预测方法——sTransformer,专门解决多配送中心(DC)供应链中的需求预测问题。随着京东等大型电商平台的规模持续扩大,其经营的商品品类日益繁多、销售波动性显著增强,如何准确预测各DC的需求成为供应链管理中的关键挑战。传统的时间序列预测方法难以有效处理来自多个DC的需求数据,尤其是当不同DC之间存在信息共享需求时。在本篇论文中,清华工业工程系与京东零售供应链技术联合研究团队提出的sTransformer结合了序列和时间卷积网络(STCN)以及序列掩码注意力(SeqMask)机制,能够同时捕捉时间维度和DC间的相互关联信息,提升了预测精度。

1 引言

在电商平台的日常运营中,需求预测是供应链管理的关键环节。它直接关系到库存优化、补货决策乃至整体运营效率。然而,实际业务中的销量预测面临多个挑战:

需要提前较长时间进行预测,以支持供应链提前部署;

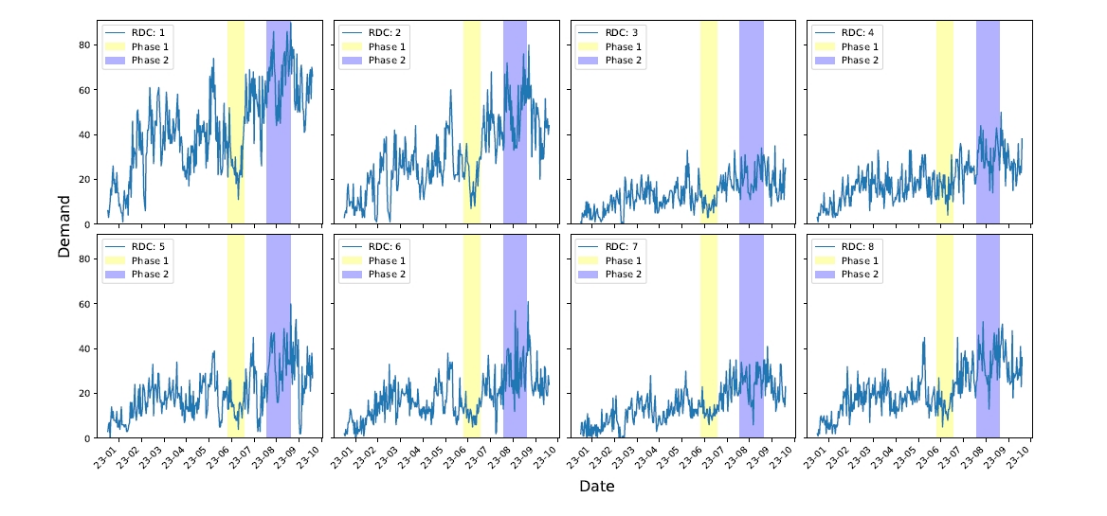

图1:图中展示的是某一商品在京东八个区域分拨中心(Regional Distribution Centers, RDCs)2023年1月至10月的实际销售数据。可以明显观察到,不同DC之间在销量上存在显著的时间差异性与数量差异性,但在时间维度上却表现出相似的趋势。

2 技术方案

基于京东实际业务背景,我们提出了 sTransformer 模型:一个针对多DC销量预测场景,能够同时建模时间依赖性与DC间序列关系的深度时序模型。

模型创新点:我们在原始 Transformer 架构基础上,引入了两项关键改进,以适配电商环境下的实际挑战。

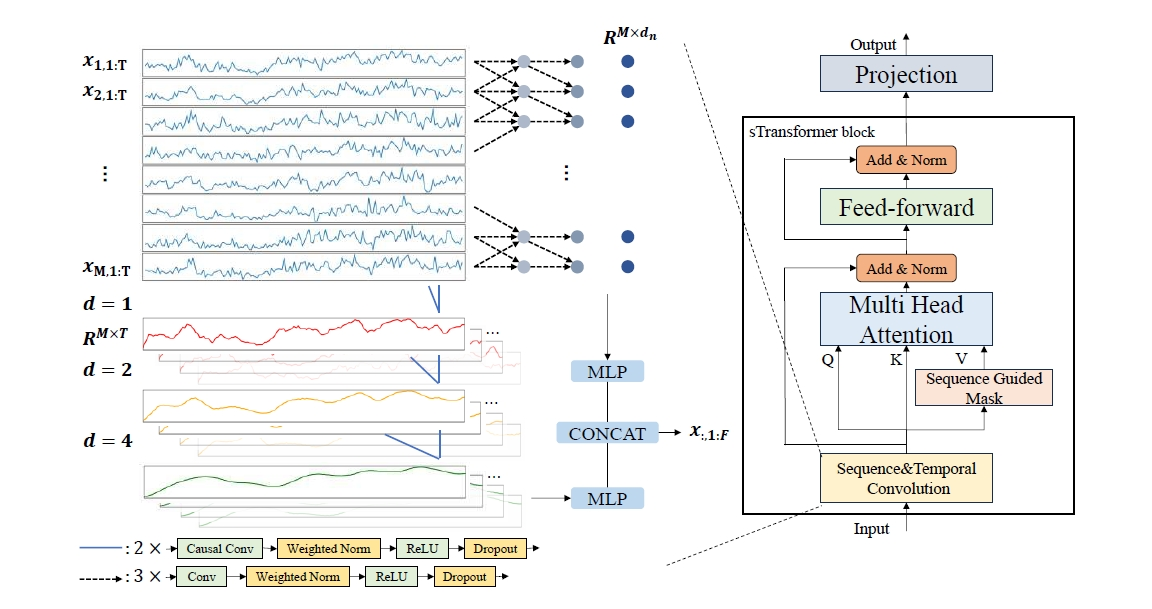

a) STCN 模块(Sequence and Temporal Convolutional Network)

STCN 在时间维度(即序列本身)与序列间维度(即不同仓库)上同时应用卷积操作,分别提取时间依赖模式与DC间关联信息,实现更具表现力的特征表示。TCN 通过扩张卷积建模时间依赖,具备因果性,确保预测不依赖未来信息;SCN 则在序列(如多仓库)维度上建模,提取序列间的关联特征。

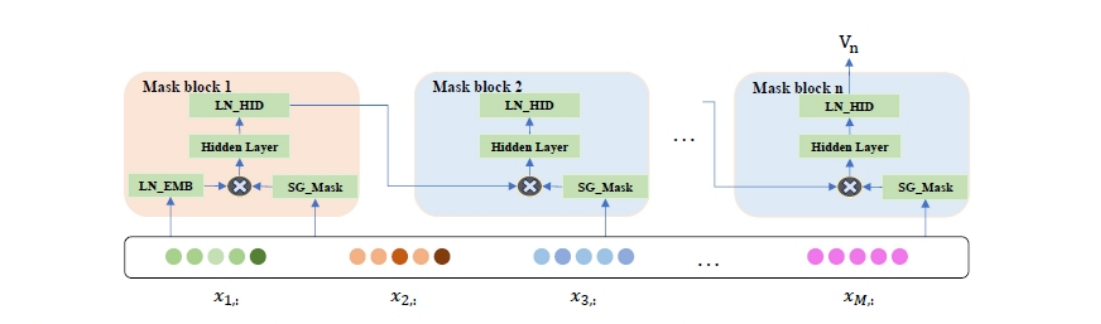

b) Sequence-Guided Mask Attention 机制

基于 MaskNet 思路,我们在注意力机制中引入序列引导的掩码操作,在保持原有 Q-K 结构的同时,使 V 层更关注全局特征信息,从而提升模型对序列间全局模式的感知能力。

3 模型效果

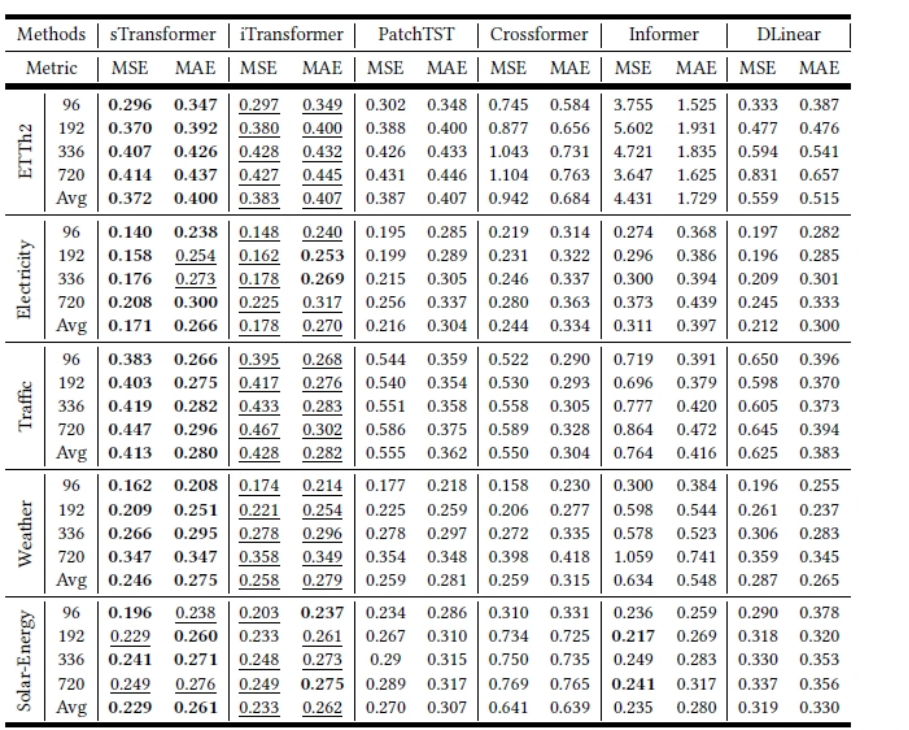

我们在多个主流公开数据集(ETT、Electricity、Traffic、Weather、Solar-Energy)以及京东自有真实多DC销量数据上进行了实验验证。实验结果表明:

在长期预测任务中,sTransformer 相较于现有 SOTA 模型(如 iTransformer、PatchTST 等)均取得更优结果;

在京东真实业务落地中,模型部署覆盖了216 个三级品类、约 14,000 个 SKU,相较于线上现有模型,预测准确率提升达5.63%。

4 结论

sTransformer具有以下关键能力与突出表现。

论文信息:

文章作者:尹嘉恒,石正新,张建申,林晓明,黄玉琳,戚永志,祁炜,胡浩

全文链接:sTransformer: Multi-Warehouse Demand Time-Series Forecasting Incorporating Inter-Sequence Information.

https://arxiv.org/abs/2408.09723

研究团队:

本文作者来自清华大学工业工程系与京东零售供应链技术联合研究团队。联合团队致力于通过AI 技术和 OR 技术的融合,提升供应链全链路的成本、效率以及体验的优化,打造供应链系统“超级智能大脑”。团队相关研究成果已经发表在Management Science, Production and Operations Management Society (POMS), Manufacturing & Service Operations Management (M&SOM)等期刊,并获得Gartner技术创新奖、INFORMS Daniel H. Wagner Prize以及INFORMS Prize等行业奖项。项目成果获得清华-京东智慧零售技术联合研究中心项目支持。